2026年5月8日

AIは「指導者の器」を露わにする

清水 さやか

早稲田大学 ビジネス・ファイナンスセンター 招聘研究員

AI活用が企業や教育現場に広がる中で、混乱や不満の声も同時に増えている。だが、そこで起きている問題の本質は、AIの性能や成熟度にあるのではない。問題は一貫して、「何のためにAIを使うのか」「どのように使わせたいのか」を定義しないまま導入している指導者の設計不在にある。

AIは指導者の代わりに判断をしてくれる存在ではない。むしろ、指導者が下した判断や姿勢を、そのまま増幅して可視化する装置である。

だからこそ、AI時代とは技術革新の時代である以上に、指導者の器が露わになる時代だといえる。

問題提起:現場の混乱はなぜ起きるのか

今や、教育現場ですらAI活用は「当たり前」になりつつある。しかし実態を見ると、「とにかくAIドリルを使え」という上位方針だけが先行し、教員自身がその目的や効果を十分に理解していないケースも少なくない。

中には、AIドリルの使い方を教員がAIに聞いている、という話すら耳にする。こうした状況では、AIを使わされる生徒側に「なぜこれをやるのか」が伝わらず、不満や疲弊感だけが残る。

ここで重要なのは、現場の混乱を「現場の理解不足」や「AIリテラシーの低さ」に帰してしまうこと自体が、問題を取り違えている点である。目的も運用も設計しないまま導入した結果として、混乱は必然的に生じているにすぎない。

AIにおける「指導者」とは何か

まず前提として、AIにおける指導者とは単に企業の経営者だけを指すのではない。より広く捉えれば、

・AIを設計する研究者

・AIを導入する企業の意思決定者

・AIを社会に適用する政策立案者

・AIを使いこなす現場のリーダー

・AIの利用を規範づける教育者

など、AIの方向性に影響を与えるすべての人が「指導者」といえるだろう。

AIは自律的に意思を持つ存在ではなく、あくまで人間が設計し、運用し、目的を与えることで初めて価値を発揮する。だからこそ、AIの成否は技術そのものよりも、それを導く人間の判断に大きく依存する。

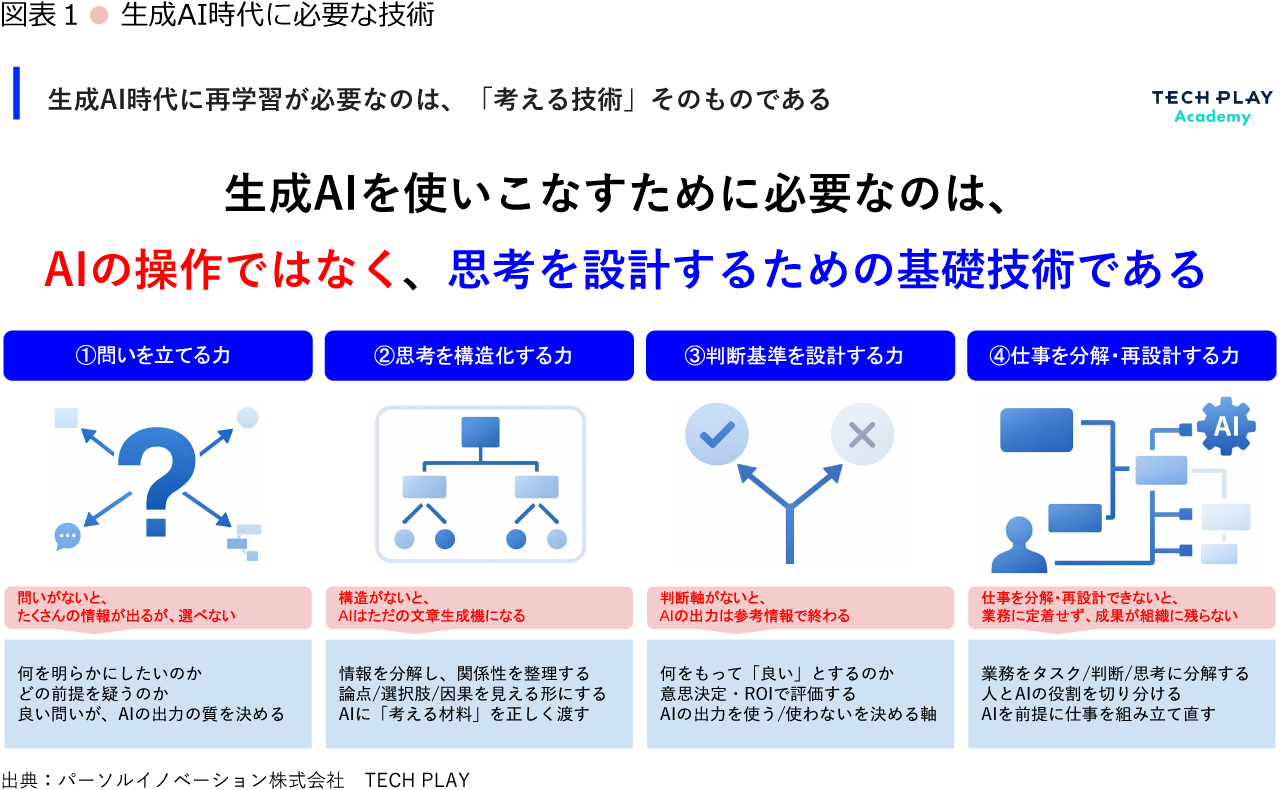

このことは、パーソルイノベーション株式会社が展開する「TECH PLAY」のウェビナーでもよく話題になっている。ここで重要なのは、AIの振る舞いはすべて人間の意思決定の延長線上にあるという点だ。つまり指導者は単にAIを“使う側”ではなく、“AIの挙動そのものを規定している存在”である。

AIの価値は「目的設定」によって決まる

AIは与えられた目的に対して最適化を行う。しかし、その目的が歪んでいれば、AIは高性能であるほど問題を拡大する。

・効率最大化だけを掲げれば、人の負担や雇用は切り捨てられる

・治安維持を名目に監視を強化すれば、プライバシー侵害が起こり得る

AIは命令を疑わない。だからこそ、目的を設定する指導者の価値観・倫理観・社会観が決定的に重要になる。

さらにいえば、目的設定とは単なる方針ではない。「何が正解で、何が評価されるのか」を定義する行為であり、現場の行動と現実の結果を直接規定する。

運用フェーズで問われる「判断の質」

AIは万能ではなく、データの偏りやモデルの限界を抱えている。そのため、AIの出力を鵜呑みにするのではなく、

・どこまで信頼できるか

・どの状況で使うべきか

・どの領域は人間が判断すべきか

を見極める力が必要だ。

この「判断の質」が、現場のリーダーによって大きく左右される。

どのような判断を「良し」とするか、その基準自体を設計しているのが指導者である。

現場での誤用やAIへの過信も、偶発的な失敗ではなく、設計の帰結として現れる。

指導者に求められる「人間中心のビジョン」

AIが高度化するほど、組織は「AIに任せる部分」と「人間が担う部分」を再設計しなければならない。この再設計には、単なる技術導入の意思決定ではなく、組織の文化や働き方そのものを変革する視点が求められる。

優れた指導者は、

・AIによって人間の創造性をどう引き出すか

・AI導入で失われる仕事にどう向き合うか

・従業員がAIを恐れず活用できる環境をどう整えるか

といった、人間中心のビジョンを示すことができる。逆に、ビジョンを欠いた指導者のもとでは、AI導入は現場の混乱や不信感を生み、組織の生産性をむしろ低下させる。

AIの暴走を防ぐのはAI自身ではなく、人間の制度設計である。つまり、AI社会の健全性は指導者のガバナンス能力にかかっている。

ここでいうガバナンスとは、「どこまでAIに委ね、どこから人間が責任を持つのか」という境界線を定義することに他ならない。この境界を曖昧にしたまま導入されたAIは、責任の所在をぼかし、組織の意思決定をむしろ弱体化させる。

そして決定的に重要なのは、AIの誤作動や現場の混乱が生じたとき、その原因をAIや現場に帰すことはできないという点である。それらはすべて、「どのように使うか」を定義し、「どこまで許容するか」を判断した指導者の意思決定の帰結である。この責任から逃れられないという前提に立てるかどうかが、AI時代の指導者の分水嶺になる。

・AIを恐れて拒絶する指導者

・AIを魔法の杖のように過信する指導者

・AIを使いこなし、人間の能力を最大化する指導者

この3者の差は、組織の成果や社会への影響に直結する。

AIは指導者の判断を増幅する装置でもある。良い指導者のもとではAIは社会を豊かにし、悪い指導者のもとではAIは問題を拡大する。だからこそ、AI時代には「誰がAIを使うか」が最も重要な問いになる。

そして、「AIならなんでもできる」 vs 「人間のほうが正確」などの、不毛な争いが起きないようにしたい。

指導者が直面する「目的迷子」問題の回避

経営層から「AIを使った何かを作れ」という曖昧な指示を受けたり、とにかくPoCをはじめる、つまりHowからはじまり目的が宙に浮いたりすることもある。そのリスクを避けるためには、以下の4つを押さえたい。

① ビジネスゴールを早期に固定

・“何を作らないか” も同時に決める。

② 可視化・透明性の徹底

・課題数の推移、進捗、速度、アウトプットの品質などを定量チェック。

・実際のエンジニアに直接聞くことも必要。

③ 文化(カルチャー)の整備

・問題を隠さず早期に共有する文化が重要。

・チーム内のコミュニケーション頻度の増加。

④ 失敗事例・成功事例の継続的収集

これらは単なる実務的なチェックリストではなく、すべて指導者が「何を評価し、何を許容し、何を止めるか」を具体化するための仕組みである。AI活用の成否は、ツールではなく、この運用設計の精度に依存する。

結論:AI時代は「指導者の責任」が可視化される時代である

AIが導入されるほど、指導者の力量は鮮明に浮かび上がる。

・AIを恐れて拒絶する指導者

・魔法の杖のように過信する指導者

・人間の能力を引き出すために使う指導者

AIは、その差を増幅させる装置である。

最終的に問われるのは、「どのような社会を望み、そのためにAIをどう使うのか」という指導者の意思だ。AIはそれを拡張するにすぎない。

結局のところ、AIの民主化が進み、技術としては面白いが変化も大きく、誰もが苦しんでいる状況ともいえる。その環境下で先に進んでいくには指導者が重要であり、能力が「希少な人」ではなく「使いこなす人」に分散する社会になる。これはチャンスでもあり、使い方を誤ると格差や混乱も拡大する――だからこそ、技術だけでなく教育・倫理・ルール作りが同時に重要になることも忘れてはならない。最終的に問われるのは、「どのような社会を望み、そのためにAIをどう使うのか」という意思である。AIはその意思を増幅するにすぎない。だからこそAI時代とは、技術の進化の時代ではなく、指導者の器と責任が露わになる時代なのである。

2026年5月8日